44 Cheat Codes for the Game of Life - Naval Ravikant (4K)

Naval Ravikant is an entrepreneur, investor and co-founder of AngelList. What does it mean to win at the game of life? Is it tons of wealth, pure happiness, infinite time, or a loving family? Today we explore the timeless question of what it means to truly live well. Expect to learn the true price of success, whether sacrificing your happiness is worth it, what advice Naval would give to his younger self, what the true source of unhappiness is for most people, how to overcome low self-esteem, what Naval would add to his ‘How To Get Rich’ thread, how to become comfortable being unapologetically selfish, what Naval sees as the next big trends in science and technology, his take on the escalating culture wars, how to get comfortable with death and overcoming grief, the best and worst ways to spend your wealth and much more… 00:00 Is Success Worth It? 07:43 Ways To Shortcut Our Desires 10:47 Is Changing Our Opinions Hypocritical? 14:35 How To Become Less Distracted By Status Games 21:02 Ways To Raise Your Self-Esteem 29:46 Why Pride Is The Most Expensive Trait 32:19 Identifying Our Happiness 44:22 The Key To Being Your Authentic Self 49:08 Objectively Viewing Our Own Mind 1:00:40 How Can We Avoid Cynicism And Pessimism Within Ourselves? 1:07:20 What Is Happiness? 1:21:24 Learning How To Deal With Anxiety 1:28:07 Optimising Our Quality Of Life 1:32:36 Why We Can't Change Other People 1:45:22 Why We Shouldn't Take Ourselves Too Seriously 1:52:38 How Being Observant Of Yourself Allows Change 2:00:23 Why Did Naval Come On This Podcast? 2:09:31 The Best And Worst Places To Spend Wealth 2:18:03 Philosophical Beliefs 2:23:55 Recent Insights Into Naval's Opinions 2:30:50 Are People Choosing To Have Less Kids? 2:37:40 Trusting Our Instincts Throughout Parenthood 2:50:26 What Does The Future Of The Culture Wars Look Like? 2:59:01 What Is Currently Ignored By The Media But Will Be Studied By Historians? 3:11:49 Is There An Advantage To Starting Out As A Loser? 3:15:20 Naval's Foreseeable Plans - Get $350 off the Pod 4 Ultra at https://eightsleep.com/modernwisdom (use code MODERNWISDOM) Get the best bloodwork analysis in America at https://functionhealth.com/modernwisdom Get a Free Sample Pack of all LMNT Flavours with your first purchase at https://drinklmnt.com/modernwisdom Get 35% off your first subscription of the best supplements from Momentous at https://livemomentous.com/modernwisdom - Get access to every episode 10 hours before YouTube by subscribing for free on Spotify - https://spoti.fi/2LSimPn or Apple Podcasts - https://apple.co/2MNqIgw Get my free Reading List of 100 life-changing books here - https://chriswillx.com/books/ Try my productivity energy drink Neutonic here - https://neutonic.com/modernwisdom - Get in touch in the comments below or head to... Instagram: https://www.instagram.com/chriswillx Twitter: https://www.twitter.com/chriswillx Email: https://chriswillx.com/contact/

www.youtube.com

本视频是 Chris Williamson 对著名企业家、投资人兼思想家 Naval Ravikant 的深度访谈。在这场对话中,Naval 分享了他对于生活、财富、幸福、自我认知以及人际关系等核心议题的深刻洞察,堪称一份“人生通关秘籍”。

Naval 挑战了许多传统的成功学观念。他提出“幸福与成功并不冲突”,相反,当一个人处于内心平静和幸福的状态时,他会更纯粹地投入到符合自己本性的事情中,从而更毫不费力地获得真正的成功。他深入剖析了“财富创造游戏”与“地位攀比游戏”的本质区别,鼓励人们追求正和的财富积累,远离零和、充满无谓消耗的地位竞争。

此外,他还探讨了如何通过坚守个人内在准则来构建高自尊,如何在充满信息噪音和焦虑的现代社会中保持情绪的抽离与稳定,以及如何面对生命的短暂。Naval 强调,人生中最宝贵的货币不是金钱甚至不是时间,而是“注意力”。这段对话是一场关于如何摆脱社会规训、回归真实自我、最终获得内心绝对自由的哲学漫谈。

LibriVox | free public domain audiobooks

librivox.org

LibriVox( https://librivox.org/ )是一个非营利性的免费公共领域有声书平台,成立于2005年,由全球志愿者共同录制和维护。其核心使命是将已进入公有领域(版权过期)的经典文学作品转化为免费音频格式,让任何人均可自由聆听和下载。

目前网站拥有超过21,000部作品,涵盖小说、诗歌、散文、历史、哲学等多种类型,支持49种语言(英语占大多数,非英语作品约占12%)。所有内容均由14,000多名志愿者以业余方式朗读录制,品质参差但完全免费、无广告、无版权限制。

用户可通过网站目录按作者、书名、类别或语言搜索,直接在线播放,或下载MP3文件到手机、电脑、播放器,也可制作成播客或刻录CD。LibriVox还提供RSS订阅和新书更新,极大方便了听书爱好者。

作为全球最大的免费有声书社区,LibriVox依赖志愿者协作精神,让无数经典文学以声音形式重获新生,尤其适合想免费听名著、练习听力或接触原版文学的人群。

XY (@xydotdot)

x.com

这篇帖子探讨了线性思维作为一种根深蒂固的认知障碍,如何限制人类的创造力和洞察力。作者分享个人经历,指出线性思维源于学校、教育和社会结构,将思考局限于狭窄的顺序路径,导致大脑的高价值功能如模式识别、创造性和突发灵感无法充分发挥。相反,大脑本是网络化的系统,想法通过交互、碰撞和重叠产生价值。作者批评将发散和收敛视为分离阶段的模型,认为大脑同时进行生成、过滤和重组。转向非线性思维后,作者在笔记和想法组织中受益,允许知识“互动”并“繁殖”新洞见。许多人误以为自己缺乏想法,其实是结构问题:强迫非线性大脑输出线性结果,只会扼杀洞察的机制。帖子强调,拥抱大脑的网络本质,能解锁更强的思考和原创性。

拥抱黑盒:一个研究者 All in AI 的实录与反思【更新:附录增加了写作过程】

正在消失的地平线 我找到了一些程序的问题,全放到了 GitHub Issues 上。睡了一觉醒来,Agent 已经自动地把这些 issues 都解决了。 这不是科幻场景。这是我这段时间常见的画面。 大学时期,一次 ACM-ICPC 比赛后和队友聊天,开玩笑说哪天我们可以写个 AI,读了这些题目自己做出来。跟 Dennis Sullivan 聊天时,他也开玩笑说,哪天数学会不会也被 AI 替代。而如今,十几年过去了,玩笑正在一点点变成现实。 我学数学出身,做理论计算机和组合优化的研究。参加过一些编程竞赛,也在大厂打过工。在 LLM(Large Language Model,大语言模型,也就是 ChatGPT、Claude 背后的技术)出来之前,我对这些东西了解得并不多。甚至对整个机器学习了解都非常少,可能比普通的计算机学生知道得还少。LLM 出来之后,我也只是有一段时间用过 ChatGPT 解决点小问题,仅此而已。 2026年一月,我和一位 Shopify 员工聊天。Shopify 大面积推行 AI 的使用,甚至是强制使用,作为 KPI 的一部分。他告诉我,使用 AI 如何改变了...

www.uscardforum.com

仔细看这个体系,会发现它和操作系统惊人地相似:LLM 是 CPU(概率处理器),上下文窗口是 RAM,MCP 是驱动协议(类似 USB 或 POSIX),Skills 是安装在 OS 上的 App,Subagents 是多任务调度中的进程。所有的 Agent 框架实际上都是在为一个基于语言模型的计算核心编写新的操作系统。

更深层的变化是,AI 正在改变你思考问题的方式。当你习惯了和 Agent 协作,你会不自觉地开始把所有问题拆解成"可验证的小步骤"——因为这恰好是 Agent 最擅长处理的形式。你的需求会表达得更精确,因为你知道模糊的指令会导致模糊的结果。为了让 AI 更高效,你自己的思维也变得更结构化了。这是一种意外的副产品:你在训练 AI 的同时,AI 也在训练你。

Tuist

The same iOS tooling that powers billion-user apps, delivered as a service for your team

tuist.dev

Tuist 是一个开源的命令行工具和平台,专为 iOS 和 macOS 开发者设计,帮助大规模管理和优化 Xcode 项目。

它允许开发者用简洁的 Swift 代码(而非手动维护复杂的 .xcodeproj 文件)来定义项目结构、目标、依赖和配置,从而自动生成一致、可维护的 Xcode 项目,避免合并冲突并简化模块化开发。

核心功能包括:

- 智能缓存:重用编译二进制,大幅缩短本地和 CI 构建时间(许多团队实测可减少 65%–80%)。

- 选择性测试:只运行受变更影响的测试,并自动检测不稳定(flaky)测试。

- 性能洞察:监控构建和测试瓶颈。

- 即时预览:通过 URL 快速分享应用,无需 TestFlight。

- AI 驱动质量保障:自动在 PR 中探索边缘场景、测试应用并附上截图/日志报告。

- 组件注册表:按需下载,减轻构建负担。

Tuist 特别适合中大型团队和复杂代码库,已被 Trendyol、Bumble、DraftKings 等公司采用,也深受独立开发者欢迎。凭借 9 年开源历史、5000+ GitHub 星标和活跃社区,它将繁琐的工具链问题转化为开发竞争优势,让团队聚焦于功能而非构建等待。

一句话总结:Tuist 把 iOS 项目从“工具限制”变成“加速器”

Nobody Gets Promoted for Simplicity

We reward complexity and ignore simplicity. In interviews, design reviews, and promotions. Here’s how to fix it.

terriblesoftware.org

本文探讨了软件工程领域中一个普遍存在的悖论:尽管“简洁”是极高的美德,但在职业晋升和企业评估体系中,往往是“复杂”获得了奖赏。作者指出,工程师们经常陷入过度工程化的陷阱,因为复杂的系统更容易构建出令人印象深刻的晋升叙事(如“设计了可扩展的事件驱动架构”),而选择最简单、最有效方案的工程师由于其成果过于“隐形”,往往在评审中被忽视。这种激励错位不仅存在于晋升环节,还根植于面试筛选和设计评审中。面试官倾向于通过增加系统复杂度来考察候选人,导致开发者误以为“复杂即专业”。

作者强调,真正的资深并非掌握更多工具,而是具备“何时不使用它们”的判断力。为了扭转这一局面,工程师需要学会为简洁“正名”,将“不做什么”的决策过程文档化,并向管理者展示简洁背后的思考深度。同时,工程领导者负有更大的责任,应从制度层面改变激励结构,在评审中质疑复杂性的必要性,并公开表彰那些通过减少代码、拒绝不必要需求而创造价值的行为。最终,只有当企业文化真正开始奖励“未被构建的复杂性”时,团队才能摆脱冗余架构的泥潭,回归高效开发的本质。

Glaze by Raycast. Desktop apps, reimagined by you.

Create software for you and your team. Lives on your Mac, connects to your files, tools and hardware.

www.glazeapp.com

Glaze 是一款由 Raycast 推出的创新工具,旨在让用户通过自然语言描述直接构建桌面应用。与传统的 Web 开发工具(如 v0 或 Bolt)不同,Glaze 专注于原生桌面环境,赋予应用访问文件系统、摄像头、快捷键及菜单栏等系统级权限,实现 Web 应用无法达到的深度集成。

核心优势:

- 零门槛构建: 用户无需编程基础,只需通过对话即可生成、修改应用;开发者亦可介入代码进行精细化调整。

- 无限场景: 支持创建团队内部工具、个人效率插件、自动化工作流或菜单栏小工具。

- 深度连接: 应用可无缝对接本地文件、硬件、各类 API 及 AI 模型。

AI Made Writing Code Easier. It Made Engineering Harder.

Writing code is easier than ever. Being a software engineer is harder than ever. The paradox nobody talks about, and what engineers and leaders should do.

www.ivanturkovic.com

AI Made Writing Code Easier. It Made Engineering Harder.

本文探讨了人工智能(AI)对软件工程行业的深远影响,提出了一个核心悖论:虽然 AI 显著降低了“写代码”的门槛,却让“做一名工程师”变得前所未有的困难。作者 Ivan Turkovic 指出,随着 AI 辅助工具和智能体的普及,代码生成的效率大幅提升,但这导致了行业基准线的无形移动。管理层往往认为 AI 减轻了负担,但现实是工程师的期望产出成倍增加,工作范围也从单纯的开发扩展到了产品思维、架构决策和复杂的系统维护。

文章引用了 2026 年《哈佛商业评论》的一项研究,显示 83% 的员工认为 AI 增加了工作量,初级员工的职业倦怠率远高于高管。这种现象源于“加速陷阱”:任务变快导致任务量增加,进而导致对 AI 的过度依赖,最终形成一个工作强度不断升级的循环。此外,工程师正面临身份危机,从“创造者”转变为“审查者”,而审查 AI 生成的代码往往比自己编写更耗时且缺乏上下文。

对于初级工程师而言,AI 吞噬了基础的练习任务,导致人才培养链条断裂。作者呼吁领导层应意识到这一转变的艰巨性,通过提供系统性培训、设定明确的角色边界、重新定义衡量指标以及保护初级人才管道来应对挑战。对于工程师个人,则建议在拥抱工具的同时,坚持掌握底层原理,并学会设定职业边界以避免倦怠。

Prompts are code, .json/.md files are state

Treating LLMs as shitty general purpose computers we program with natural language. Because throwing shit at the wall wasn't working anymore.

mariozechner.at

本文探讨了在处理大型、成熟代码库时,如何通过将大语言模型(LLM)视为一种“性能较差的通用计算机”来提升 AI 代理(Agents)的工作效率。作者 Mario Zechner 指出,当前的“代理工程”往往缺乏工程严谨性,开发者通常只是向 AI 投喂信息并祈祷结果正确。在大型项目中,LLM 面临上下文缺失、缺乏审美(倾向于生成过度设计的代码)以及上下文降级(超过 100k token 后性能下降)等痛点。

为了解决这些问题,作者提出了一套方法论:提示词(Prompts)即代码,.json/.md 文件即状态。在这种模型下,“程序”是用自然语言编写的提示词,它定义了逻辑和控制流;“输入”是代码库文档和用户指令;“状态”则序列化存储在磁盘上的 JSON 或 Markdown 文件中,而非仅仅依赖不稳定的模型上下文。这种方式实现了工作流的可重现性和确定性。

文章以将 Spine 动画运行时从 Java 移植到 C++ 的真实案例展示了这一方法的威力。通过预先生成的 porting-plan.json 跟踪进度,并使用 port.md 作为执行脚本,作者引导 Claude Code 按照严格的步骤(查找待处理类型、打开相关文件、人工确认、执行移植、编译测试、更新状态)进行操作。这种结构化的方法将原本需要 2-3 周的人工移植工作缩短到了 2-3 天。作者强调,这种思维转变将 AI 辅助编程从一种随机的尝试转变为一种可控的工程学科。

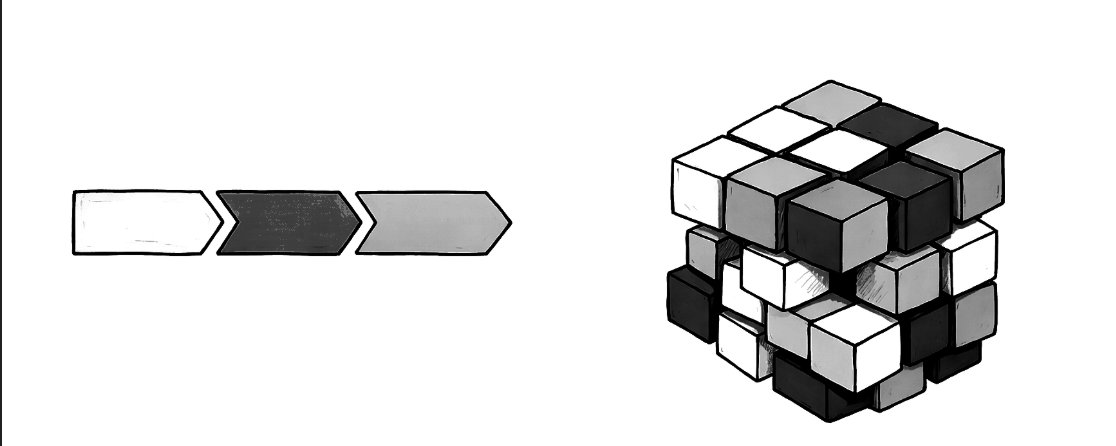

My AI Workflow for Understanding Any Codebase | Peter Steinberger

A quick tip on how I use repo2txt and Google AI Studio to understand new codebases. Gemini's 1M token context window is perfect for asking questions about code.

steipete.me

本文详细介绍了开发者 Peter Steinberger 如何利用大语言模型(尤其是 Google Gemini)的超长上下文特性,构建一套高效的代码库理解与开发工作流。核心思路是将复杂的 GitHub 仓库转化为结构化的 Markdown 文本,并利用 Gemini 的海量上下文窗口进行深度分析。

工作流分为几个关键阶段:首先,通过 repo2txt 工具将代码库转换为文本,剔除无关的二进制文件和测试代码,以保持上下文的纯净。其次,利用 Google AI Studio 强大的处理能力,对代码进行架构分析和逻辑溯源。在开发新项目时,作者提出了一套“从创意到软件设计文档(SDD)”的严谨流程,其中最亮眼的是“双上下文技术(Two-Context Technique)”:一个窗口负责编写和维护规格说明,另一个窗口负责扮演“挑刺者”角色,通过 3-5 轮的对抗性迭代,使设计文档达到无懈可击的程度。

在实现阶段,作者推荐将完善后的 SDD 作为 spec.md 存入仓库,并调用 Claude Code 等代理工具进行自动化构建。这种方法将 AI 的角色从简单的辅助编码提升到了系统级的设计与执行。此外,作者还分享了应对 AI “上下文失忆”的策略(如分块生成和手动维护主文档),并探讨了“代码即规格”的理念,即通过旧代码直接生成新架构的设计文档。该工作流不仅提升了理解现有代码的效率,也极大地缩短了从想法到产品的落地周期。

Best Practices for Claude Code - Claude Code Docs

Tips and patterns for getting the most out of Claude Code, from configuring your environment to scaling across parallel sessions.

code.claude.com

Claude Code 是一个代理式(Agentic)编程环境,它超越了传统聊天机器人的范畴,能够自主读取文件、运行命令、修改代码并解决复杂问题。本文档核心观点认为,要发挥 Claude Code 的最大潜力,开发者需要从“自己写代码”转变为“描述需求并引导代理执行”。

文档强调,上下文窗口管理是使用中的核心约束。随着对话增长,Claude 的性能会因上下文填满而下降,导致遗忘指令或产生错误。因此,高效使用的关键在于:1. 提供验证手段:通过测试用例、截图或预期输出来让 Claude 自我校验,这是提高成功率的最强杠杆;2. 遵循科学工作流:采用“探索-计划-实施-提交”的四阶段模式,利用“计划模式(Plan Mode)”分离思考与执行;3. 精准的上下文注入:利用 @ 引用文件、粘贴图片或通过管道传输数据,减少模糊性。

在环境配置方面,文档详细介绍了 CLAUDE.md 的作用,它是跨会话持久化项目规范的关键。此外,通过配置权限、集成 CLI 工具(如 gh)、连接 MCP 服务器以及创建自定义技能(Skills)和子代理(Subagents),可以极大地扩展 Claude 的能力。最后,文档提出了规模化作业的思路,如非交互模式、并行会话和扇出式(Fan-out)任务分配,并总结了应避免的常见失败模式(如“大杂烩”会话和过度复杂的配置)。

Effective harnesses for long-running agents

Anthropic is an AI safety and research company that's working to build reliable, interpretable, and steerable AI systems.

www.anthropic.com

随着 AI 智能体(Agents)能力的增强,开发者开始要求它们处理跨越数小时甚至数天的复杂任务。然而,让智能体在多个上下文窗口(Context Windows)中保持一致的进度仍是一个难题。核心挑战在于,长时运行的智能体必须以离散的“会话”形式工作,而每个新会话开始时都没有之前的记忆,就像一群轮班工作的工程师,每个人到岗时都不知道前一班发生了什么。

为了解决这一“失忆”问题,Anthropic 开发了一套双重方案,并集成在 Claude Agent SDK 中。该方案包含两个核心角色:初始化智能体(Initializer Agent)和编码智能体(Coding Agent)。初始化智能体负责在首次运行时搭建环境,包括创建功能列表(JSON 格式)、初始化 Git 仓库、编写环境启动脚本(init.sh)以及进度记录文件(claude-progress.txt)。编码智能体则负责在后续的每个会话中进行增量开发,确保每次只处理一个功能,并在结束时留下清晰的工件(Artifacts)供下一班次使用。

研究发现,智能体常见的失败模式包括:试图一次性完成所有工作(One-shotting)导致上下文耗尽、在功能未完成时过早宣布胜利、以及缺乏端到端测试。通过引入结构化的 JSON 功能清单、强制性的 Git 提交记录以及基于 Puppeteer 的浏览器自动化测试,Claude 能够更有效地识别 Bug 并保持代码库的整洁。这种方法不仅提高了开发效率,还确保了智能体在进入新会话时能通过运行 pwd、阅读日志和执行初始化脚本快速进入状态。尽管仍存在视觉识别局限等挑战,但这一框架为长时运行的 AI 协作提供了可行的工程路径。

AI Made Writing Code Easier. It Made Engineering Harder.

Writing code is easier than ever. Being a software engineer is harder than ever. The paradox nobody talks about, and what engineers and leaders should do.

www.ivanturkovic.com

本文探讨了人工智能(AI)对软件工程行业的深远影响,提出了一个核心悖论:虽然 AI 让“写代码”变得前所未有的简单,但却让“做工程师”变得更加困难和复杂。

作者指出,自 2023 年以来,软件工程师的产出基准线在无形中被大幅拉高。AI 工具缩短了编写代码的时间,但这并没有让工程师早点下班,反而导致了工作量的急剧扩张和职业倦怠。根据 2026 年的研究,超过 80% 的员工感到工作量增加,而管理层对此却缺乏共识。

这种转变引发了工程师的“身份危机”。许多人入行是因为热爱解决问题和编写代码的创造感,但现在他们正被迫转变为“代码审查员”,在永不停歇的自动化流水线上进行质量把控,失去了手工艺人的成就感。同时,工程师的职责范围也在剧烈扩张,他们现在需要兼顾产品思维、架构决策、安全评估和运维,这种“全栈化”往往演变成了无偿的职责蔓延。

此外,文章提出了“监督悖论”:审查 AI 生成的代码往往比自己亲手写代码更累,因为 AI 产出的代码缺乏决策背景和逻辑推导过程。对于初级工程师来说,AI 正在吞噬他们的“练手”机会,导致行业人才梯队面临断裂风险。

最后,作者呼吁领导层重新审视衡量标准,从关注产出速度转向关注系统稳定性、代码质量和团队健康;同时也建议工程师坚守技术基础,学会设定界限,并在新的职业版图中寻找机会。

Developers, Reinvented – Thomas Dohmke

What started as fear of AI replacing developers is switching to pragmatically embracing the ambitious reality of AI and viewing it as a growth opportunity. As we build the tools of tomorrow, we can usher developers through this reinvention of their role in ways that are intuitive, delightful, and cater to developers’ curiosity, keeping them fulfilled and happy during the transition. That makes us optimistic. Realistically.

ashtom.github.io

The developers at stage 4 unanimously declare their role has shifted. They now focus on the delegation and the verification of a task. Delegation is about setting up the agents for success with rich context and instructions, designing and refining prompts, reviewing AI’s plans and tradeoffs, and tweaking before proceeding. Verification is all about tearing down the agent’s work – they review and validate that the AI-generated implementation fulfills the objectives and conventions it needs to. These developers moved from writing code to architecting and verifying the implementation work that is carried out by AI agents.

Developers rarely mentioned “time saved” as the core benefit of working in this new way with agents. They were all about increasing ambition.

本文探讨了人工智能(AI)如何深刻地重新定义软件开发者的角色、工作流及职业身份。通过对 22 位深度使用 AI 工具的开发者进行访谈,GitHub CEO Thomas Dohmke 指出,软件开发正经历一场从“编写代码”到“编排与验证代码”的根本性转变。

开发者在拥抱 AI 的过程中通常经历四个阶段:从最初的怀疑者(仅尝试简单任务),到探索者(开始处理调试和样板代码),再到协作共创者(在 IDE 中进行多步骤协作),最终进化为战略家(构建多智能体工作流,专注于任务的委派与验证)。访谈显示,大多数开发者认为在未来 2 到 5 年内,AI 将编写 90% 的代码,但这并不意味着开发者的价值消失,而是其身份转变为“代码创意总监”或“代码使能者”。

文章提出了“务实乐观主义”的观点:虽然传统编码角色会演变,但软件开发岗位需求预计将增长 18%。为了适应这一变化,开发者需要掌握 AI 流感度、委派与编排、验证与质量控制、以及更深层次的系统架构和产品理解能力。同时,计算机科学教育也必须随之重塑,从教授语法转向培养系统建模、AI 协作和复杂问题解决能力。总之,这场变革并非取代人类,而是通过 AI 提升开发者的能力上限,让他们从繁琐的实现细节中解放出来,专注于更高维度的创造与架构。

Harness engineering: leveraging Codex in an agent-first world

By Ryan Lopopolo, Member of the Technical Staff

openai.com

本文介绍了 OpenAI 进行的一项为期五个月的工程实验:在“智能体优先”(Agent-first)的世界中,利用 Codex(基于 GPT-5)构建并交付了一款内部 Beta 软件产品,且未手动编写任何一行代码。该产品拥有数百万行代码,涵盖了应用逻辑、测试、CI 配置、文档及监控工具,开发效率提升了约 10 倍。

实验的核心结论是:在智能体时代,工程师的角色发生了根本性转变。人类不再是代码的编写者,而是环境的设计者、意图的指定者和反馈循环的构建者。团队通过“人类引导,智能体执行”的模式,实现了平均每人每天 3.5 个 PR 的高产出。为了让智能体高效工作,团队采取了一系列创新措施:首先,提高应用的“可读性”,通过集成 Chrome DevTools 和本地观测栈(Logs/Metrics),让智能体能自主调试 UI 和性能;其次,将代码库(Repository)作为唯一的知识来源,通过结构化的文档和 AGENTS.md 索引,解决上下文稀缺和规则陈旧的问题;最后,通过极其严格的架构分层和自定义 Linter 强制执行“工程品味”,防止架构漂移。

此外,实验还揭示了高吞吐量下的新挑战,如“AI 废料”(AI slop)的堆积。团队通过引入“黄金原则”和自动化的“垃圾回收”机制(即定期运行重构智能体)来保持代码库的健康。这种模式证明了,只要拥有正确的脚手架和反馈系统,智能体可以实现从发现 Bug 到修复、验证并合并 PR 的全自动化闭环。

Axiom — Observability, re-invented.

Cloud-native architecture meets built-in tracing and AI telemetry. Experience log management without compromise.

axiom.co

Axiom 是一家致力于重新定义“观测性”(Observability)的云原生平台,专为大规模工程团队设计。其核心理念是将原本被视为负担的海量日志转化为企业的战略资产。Axiom 提供了一个统一的平台,集成了日志管理、分布式追踪和指标监控,特别针对现代 AI 工程化需求进行了深度优化。

该平台的核心优势在于其卓越的扩展性和成本效益。通过创新的架构,Axiom 能够实现 PB 级数据的实时摄取与查询,并提供超过 95% 的数据压缩率,使得企业能够以极低的成本长期保留全部原始数据。在功能层面,Axiom 引入了强大的管道处理语言(APL),支持虚拟字段和查询时转换,极大提升了数据分析的灵活性。

针对当前火热的 AI 领域,Axiom 推出了专门的 AI 工程工具包。它允许开发者评估 Prompt 效果、追踪 AI 代理(Agent)的多步工作流,并自动监控不同模型供应商的成本、延迟和 Token 消耗。此外,Axiom 强调“快速实现价值”,用户可以在 5 分钟内完成部署,并在 60 天内看到显著的投资回报(ROI)。目前,已有超过 40,000 家组织(包括 Vercel、Netlify 和 Asana 等)采用 Axiom 来驱动其数据决策。其定价模式透明且灵活,采用基于使用量的计费方式,消除了传统企业级软件复杂的谈判过程和人为的功能限制。

My Current AI Dev Workflow | Peter Steinberger

Went fully back to Ghostty, VS Code on the side, and Claude Code as my main driver. Here's what actually works after months of experimentation.

steipete.me

Peter Steinberger 在本文中分享了他截至 2025 年 8 月的最优 AI 开发工作流。其核心理念是“少即是多”(Less is More),强调通过极简的工具链实现最高生产力。他目前的工作流已从完全依赖 VS Code 转向以 Ghostty 终端 + Claude Code (CLI) 为核心的模式。

在硬件方面,他推崇戴尔 UltraSharp U4025QW 40 英寸显示器,其超宽分辨率允许同时显示 4 个 Claude 实例和浏览器,无需频繁切换窗口。在软件工具上,他放弃了不稳定的 VS Code 内置终端,转而使用 Ghostty。虽然他仍保留 VS Code 用于代码查看,并使用 Cursor 或 GPT-5 进行代码审查,但主要的编码和重构工作由 Claude Code 承担。

Peter 强调了“上下文管理”的重要性。他通过在状态栏显示会话 ID、使用 CLAUDE.md 记录环境配置、以及坚持在同一上下文中编写测试来优化 AI 的表现。他认为,虽然 AI 代理(Agents)非常强大,但人类的实时引导(Steering)至关重要,以防止 AI 偏离方向。此外,他倾向于使用具有强大 CLI 支持的服务(如 Vercel、psql、gh),因为这能让 AI 代理更高效地执行任务。尽管 Claude 的费率限制可能带来挑战,但他认为目前没有更好的替代方案,这种工作流极大地提升了他的开发效率。

Shipping at Inference-Speed | Peter Steinberger

Why I stopped reading code and started watching it stream by.

steipete.me

本文由 Peter Steinberger 撰写,探讨了在 2025 年底,随着 AI 模型(特别是 GPT-5.2 和 Codex)的进化,软件开发范式发生的剧变。作者提出了“以推理速度交付”(Shipping at Inference-Speed)的概念,认为现在的开发瓶颈已不再是编写代码,而是 AI 的推理时间和人类的深度思考。

文章详细对比了 OpenAI 的 Codex 与 Anthropic 的 Claude (Opus) 在实际工程中的表现。作者指出,Codex 虽然在响应速度上可能较慢,但其在编写代码前会进行长时间的全局阅读和深度思考,从而在处理大型重构和复杂功能时具有更高的“一次性成功率”。作者分享了其高度自动化的工作流:不再依赖传统的 IDE(如 Xcode),而是通过 CLI 和 Agent 直接驱动开发;不再编写详尽的 Prompt,而是通过简短指令、截图和跨项目参考来引导 AI。

此外,作者介绍了其开发的工具(如 oracle、VibeTunnel、Clawdis),展示了 AI 如何全方位接管从系统底层转换到智能家居控制的各项任务。他强调,现代开发者的核心竞争力在于选择技术栈、设计系统架构以及与 AI 协作的直觉。最后,作者分享了其 Codex 配置文件,为追求极致开发效率的工程师提供了实践参考。

Thariq (@trq212)

x.com

本文由 Anthropic 的工程师 Thariq 分享,深入探讨了在构建 AI 智能体(Agent)工具空间(Action Space)时的核心理念与实战经验。作者提出,构建智能体最难的部分在于设计其工具集,而成功的关键在于“像智能体一样思考”,即根据模型自身的能力边界来量身定制工具。

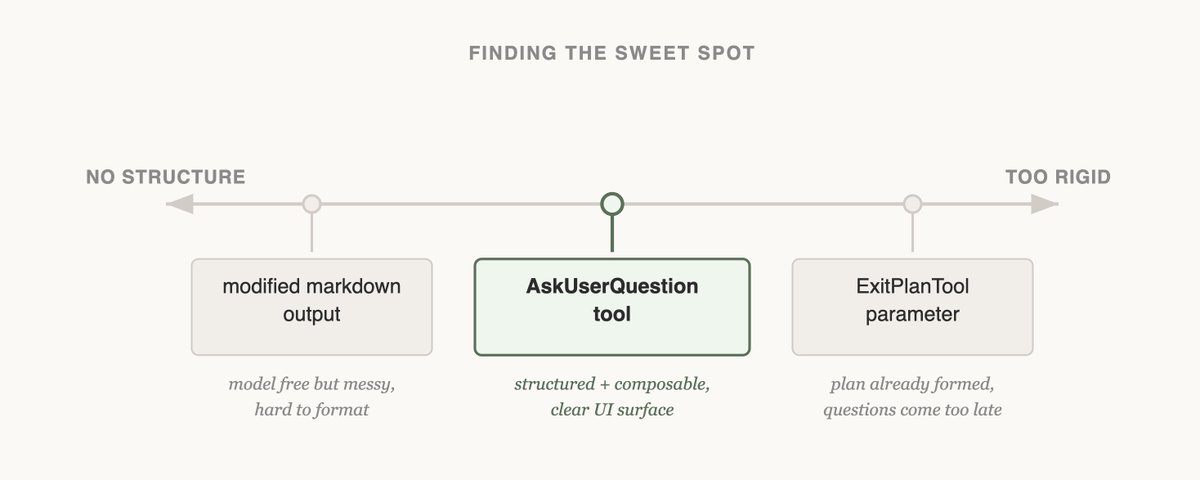

文章通过四个核心案例展示了工具设计的演进过程:首先是提问机制的优化,从简单的参数添加、格式约定,最终演变为独立的 AskUserQuestion 工具,以实现高效的人机协作;其次是任务管理系统的升级,随着模型能力的提升,从被动的 Todo 列表转向了支持多智能体协作、具备依赖关系的 Task 工具;第三是上下文构建的转变,从依赖外部 RAG 检索转向赋予模型 Grep 等搜索工具,让模型通过“渐进式披露”自主探索代码库;最后是复杂功能的解耦,通过引入专门的子智能体(如 Guide Agent)来处理特定领域的知识,避免了系统提示词的臃肿。

作者强调,工具设计并非一成不变的科学,而是一门需要不断实验、观察模型输出并随模型能力提升而迭代的艺术。开发者应保持工具集的精简,避免“上下文腐败”,并始终关注模型在特定环境下的实际表现。