一文概览深度学习中的激活函数

这篇文章是对这篇英文文章的翻译,可以从较高维度了解深度学习大概是怎么运作的。

说回生物神经网络,一个典型神经元的物理结构包括细胞体(cell body)、向其他神经元发送信号的轴突(axon)和接收其他神经元发送的信号或信息的树突(dendrites)。

上图中,红色圆圈代表两个神经元交流的区域。神经元通过树突接收来自其他神经元的信号。树突的权重叫作突触权值(synaptic weight),将和接收的信号相乘。来自树突的信号在细胞体内不断累积,如果信号强度超过特定阈值,则神经元向轴突传递信息。如未超过,则信号被该神经元「杀死」,无法进一步传播。

可以从流体动力学来理解,如果「流」向树突的信号很强,那么就更有可能「冲破」神经元的阻碍,流向更多的神经元。

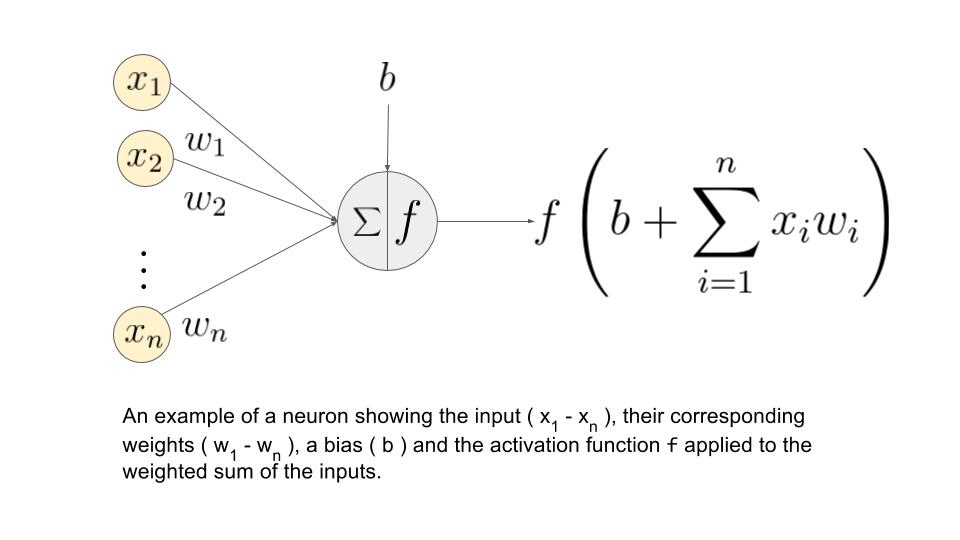

对这个机制进行人工建模就会是这样:

f 是激活函数,里面的数值就是所连接的神经元们传过来的数值*权重之和,再加上一个偏置项(从理解流程角度,可以先不考虑这个值)。

接下来的问题就是:什么是激活函数?为什么需要激活函数?

激活函数简单理解就是对接收到的输入再做一次转换,映射成新的数值传递给下一个神经元。有了激活函数就可以使神经网络随意逼近复杂函数。

文中还展示了不同的激活函数,和它的使用场景以及局限,可以一并了解下。

❤️